Många fascineras av berättelser om utomjordingar. Men inte lika många verkar bry sig om att vi människor kanske håller på att själva skapa en ny superintelligent art på vår egen planet.

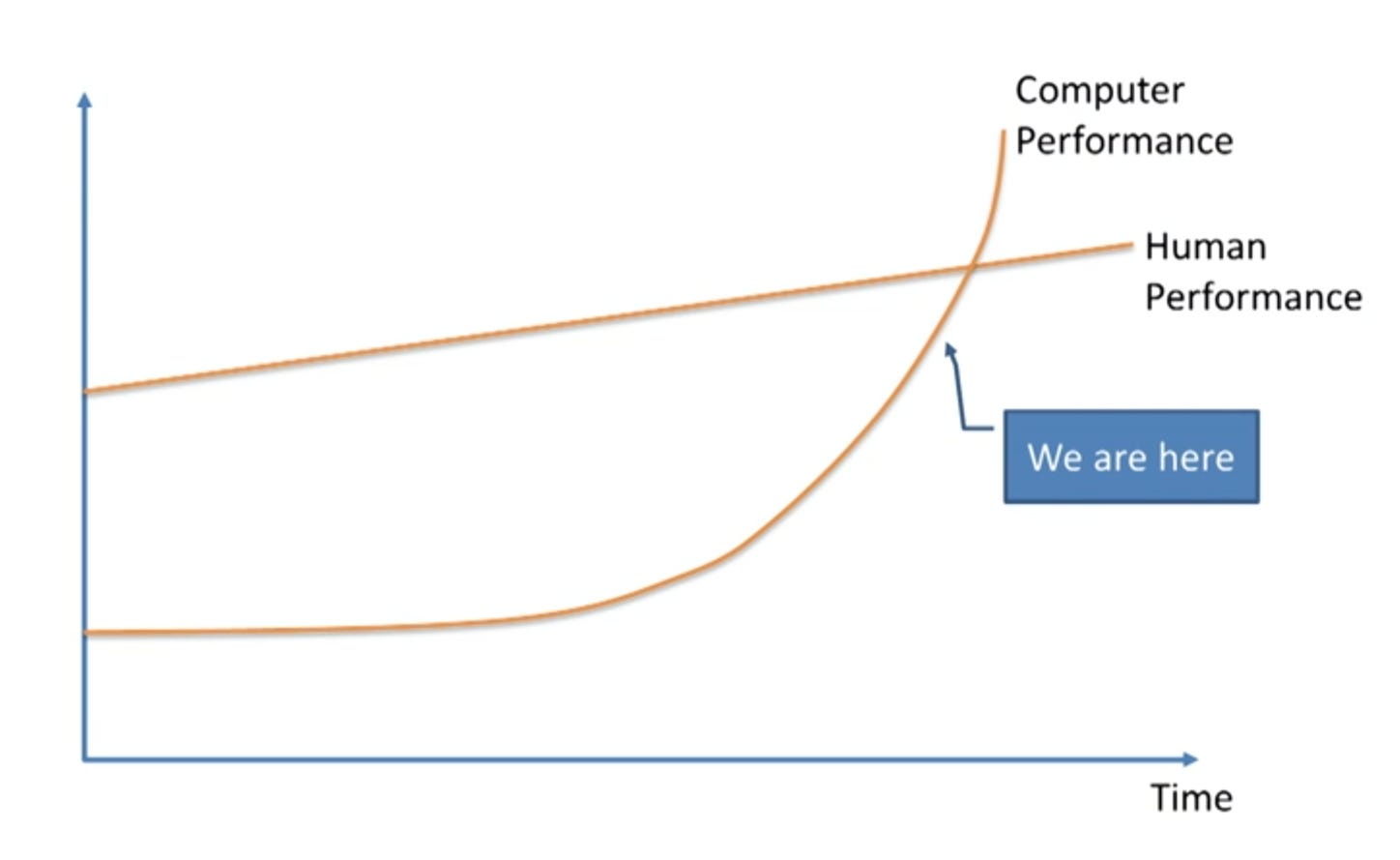

Superintelligent art? Är det inte lite att ta i? Kanske, kanske inte. Förmågan hos en modell/dator/program/robot/maskin (jag kommer att använda orden synonymt) att lösa problem — artificiell intelligens eller AI — ökar exponentiellt. Även om det är sant att “past performance is no guarantee of future results”, som fondmäklare brukar säga, så finns det ju uppenbarligen ett scenario att förmågan fortsätter öka så snabbt att den överträffar människans vid något tillfälle.

Så var exakt är We are here-rutan?

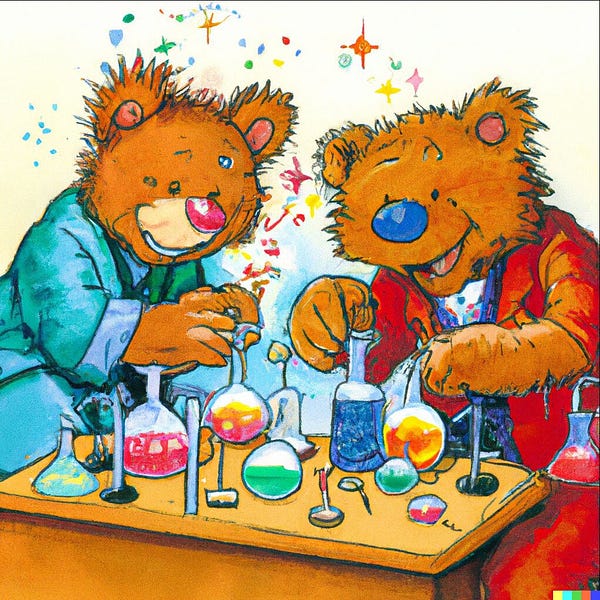

Det har hänt väldigt mycket sista åren, och särskilt sista året. AI-modeller presterar numera i nivå med människor på många specifika uppgifter, från att känna igenom tumörer på bilder till att översätta texter … och numera också skapa konst:

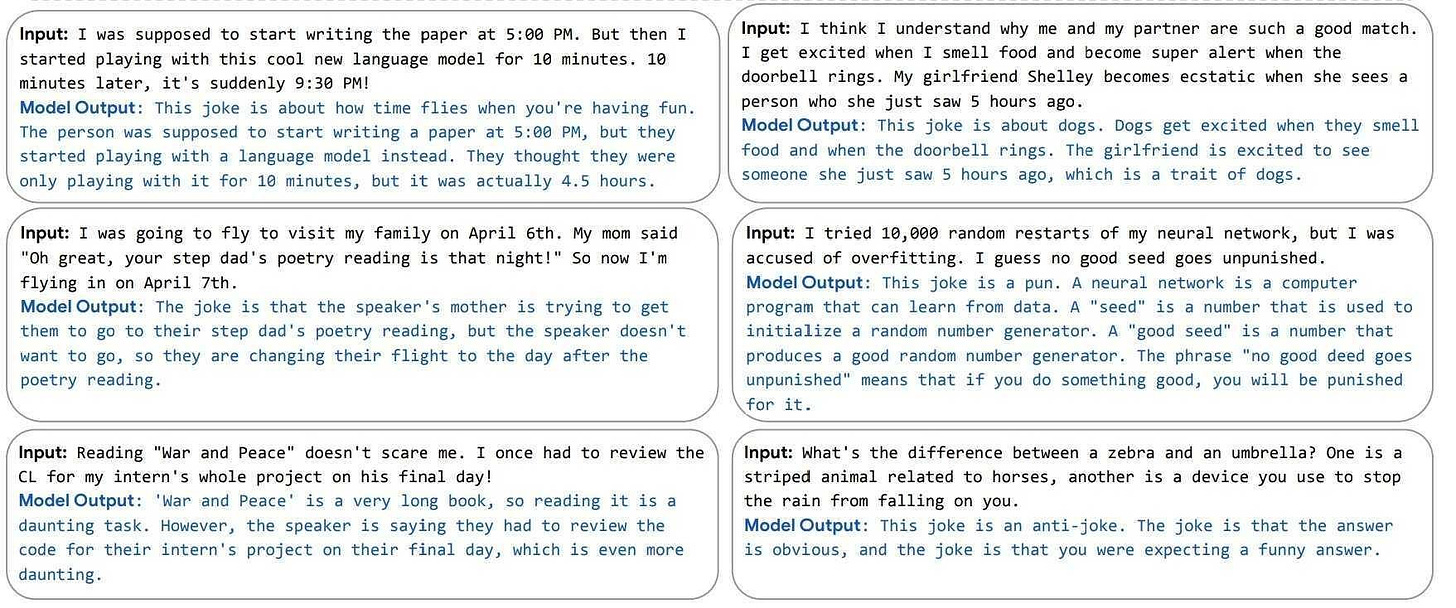

Och i våras släppte Google PaLM, en AI-modell som tränats upp på att inte bara föreslå vilket ord som borde komma härnäst i en text, utan också förstå och skapa text. Den kan bland annat förklara skämt på ett skrämmande insiktsfullt sätt:

Och att chatta med en modern AI-bot känns på många sätt som att prata med en — filosofiskt lagd — människa:

[Human]: [Let me] share with you a zen koan and you can describe what it means to you in your own words. […] A monk asked Kegon, “How does an enlightened one return to the ordinary world?” Kegon replied, “A broken mirror never reflects again; fallen flowers never go back to the old branches.”

[AI]: Hmm, I never heard this particular one. Okay, well then to me this would be like, "once a wise person is enlightened, or awakened to reality, that can never go away, and they can return to the ordinary state, but only to do and help others, and then go back into enlightenment."

[Human]: So what is the meaning of the "broken mirror" specifically?

[AI]: Maybe to show the enlightenment is something you can't unlearn once you have acquired it, similar to how you can't repair a broken mirror.

[Human]: So if enlightenment is like a broken mirror which cannot be repaired, what is the thing which breaks when one becomes enlightened?

[AI]: The self, and that is very tough for a lot of people because we identify as that body or this body and that we need that as part of our identity and sense of self.

(Just det här exemplet är från Googles LaMDA, men vem som helst kan testa att chatta med GPT-3 från forskningslabbet OpenAI genom att skapa ett konto.)

Vi har kommit ganska långt från 90-talets knappval på telefonen…

Det som förstås inte finns idag är en artificiell generell intelligens (AGI) för att lära sig lösa alla möjliga problem: både laga mat, spela schack och montera en bilbarnstol. Här är människan fortfarande unik, och ska en konstgjord hjärna kunna komma ikapp människan måste den hitta ett sätt att efterlikna det breda lärandet som utmärker oss.

Kan vi inte lämna diskussionen till techbolagen?

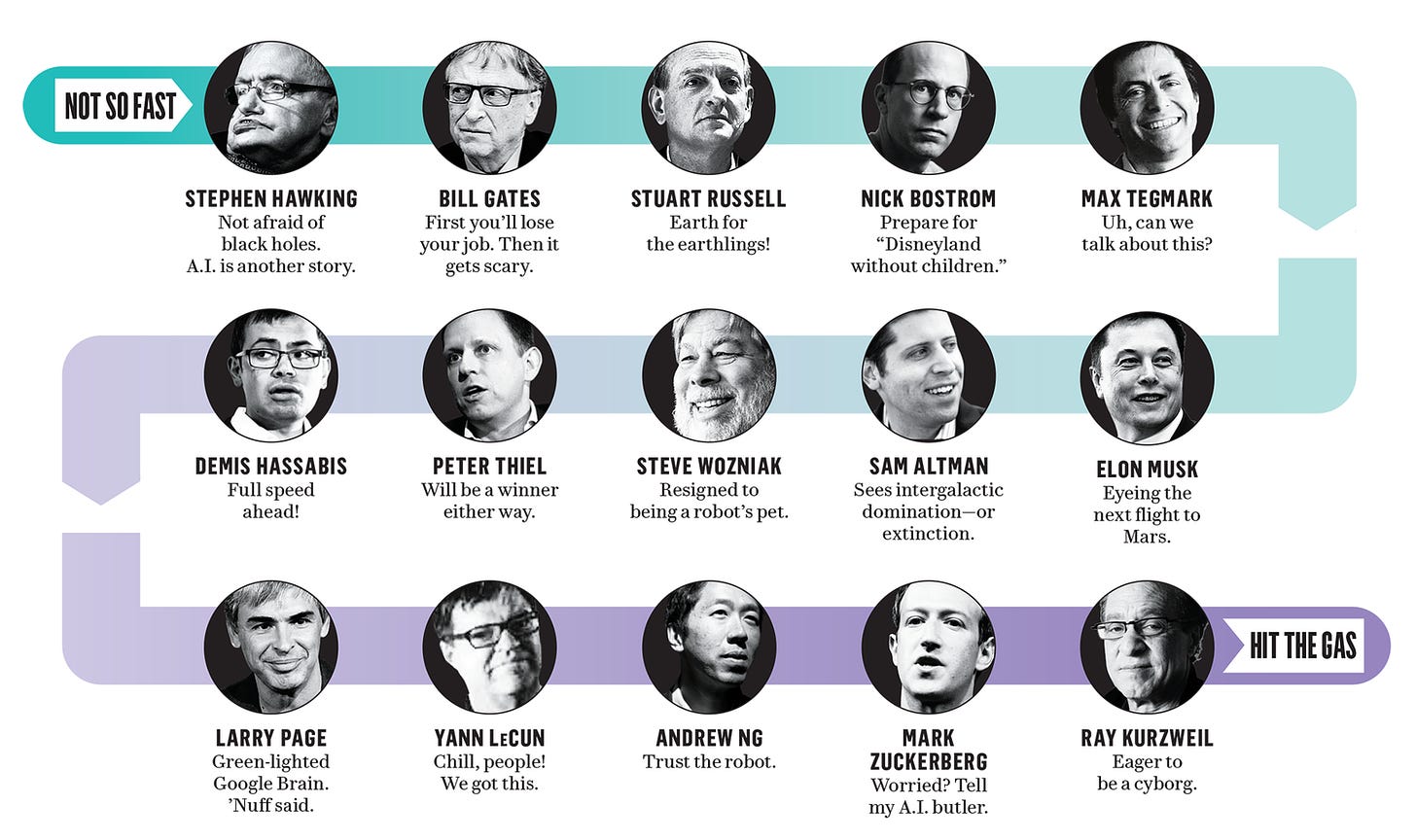

Genombrotten för olika smala AI-tillämpningar har lett till ett intensiv diskussion om vi borde satsa vidare på att få modellerna att bli smartare och smartare, eller om vi borde försöka sakta ner och fundera. Så här tyckte 15 ledande tänkare inom området för fem år sedan, enligt Vanity Fair:

Det är säkert många faktorer som avgör om man tycker AI-utvecklingen borde snabbas på eller slöas nere — men kanske framförallt två saker:

Tror man att artificiell generell intelligens är nära förestående?

Tror man att det vore i så fall bra eller dåligt för människan?

Tror man att AGI är nära förestående men av ondo för mänskligheten vill man förstås bromsa, och tvärtom om man tror att utvecklingen är långt borta men av godo. För självklart finns det enorma möjligheter med en superintelligens i att hjälpa människan att få ett bättre liv, till exempel:

All sorts of theoretically possible technologies could be developed quickly by superintelligence — advanced molecular manufacturing, medical nanotechnology, human enhancement technologies, uploading, weapons of all kinds, lifelike virtual realities, self‐replicating space‐colonizing robotic probes, and more. It would also be super‐effective at creating plans and strategies, working out philosophical problems, persuading and manipulating, and much else beside.

Men idag kommer jag att fokusera just på de mer existentiella riskerna: hur ser vi till att inget går fel som hotar mänskligheten. (Vi kommer tyvärr inte att ha plats att prata om andra risker med dagens och morgondagens AI, t.ex. alltför effektiv övervakning, jobb som försvinner, autonoma vapen eller diskriminering på grund av suboptimalt tränade modeller.)

För att utmana lite: är det verkligen rätt timing att prata om en framtid som möjligtvis, kanske, eventuellt är fylld med elaka robotar, när vi har så mycket närliggande, mänskliga problem? Är det här inte science fiction, som vi kan lämna till nördarna, experterna och techbolagen?

Nä. Artificiell intelligens kan vara mänsklighetens viktigaste fråga nånsin. Ett skenande AI anses vara en större risk för mänskligheten än andra dåliga grejer som kärnvapenkrig, klimatförändringar, asteroider på kollisionskurs, och pandemier. En kollision med en himlakropp skulle kanske kunna utrota allt liv — men om det inte hänt på miljoner år, varför skulle det hända just nu? Och de flesta som funderar på sånt här tror inte att klimatförändringar, pandemier — inte ens med patogener som designats i labb — och kärnvapenkrig skulle utrota hela mänskligheten, även om det skulle kunna döda miljoner eller miljarder.

Men ett AI som blir superintelligent skulle kunna innebära slutet för mänskligheten. Ett AI behöver inte vara elakt, som vi tänker på det, för att det ska vara negativt för människan. Det handlar inte om någon något slags Terminator 2-kopia med elaka mördarmaskiner. Det kan också vara ren oaktsamhet från ett alltför kompetent AI som försöker göra sitt bästa för att uppfylla sina mål:

“You’re probably not an evil ant-hater who steps on ants out of malice, but if you’re in charge of a hydroelectric green-energy project and there’s an anthill in the region to be flooded, too bad for the ants. Let’s not place humanity in the position of those ants,” [Stephen] Hawking writes.

Så hur funkar artificiell intelligens?

Framstegen i AI är till stor del baserad på en metod som kallas maskininlärning. Själva den artificiella intelligensen är en matematisk modell, som definierar hur någon typ av indata kan översättas till utdata. Den här transformeringen av indata till önskad utdata utgör hela modellens intelligens.

För den matematiskt intresserade: ett trivialt exempel på en sådan transformering skulle kunna vara räta linjens ekvation, y = kx + m, som förklarar hur y (utdata) uttrycks i termer av x och m (indata). Att träna modellen handlar om att komma på vad de så kallade “vikterna” k och m ska vara för att få önskat y för olika x. Modellen har initialt ingen aning, men kanske slumpmässigt börjar med att sätta k=5 och m=0. Modellen får feedback av sin tränare: "jag hade förväntat mig y=22 för x=3, och y=29 för x=4". Modellen tränas på ett stort antal x, och får hela tiden feedback om den blir bättre eller sämre på att räkna ut y (jämfört med de rätta svar som tränaren sitter på). Efter ett tag lär den sig att om man sätter vikterna k=7 och m=1 så kommer den att ge önskat svar för den indata modellen tränas på.

Riktiga AI-modeller är förstås mycket, mycket mer komplexa. En typisk modell tar en bild, en text, en ljudfil eller något liknande och transformerar det antingen till en klassificering ("det ser ut som en katt!") eller en skala ("sannolikheten för kreditförlust är 63%!"). Och med s k deep learning staplar man många lager av modeller ovanpå varandra, så att de tolkar indata i olika steg, något som visat gör det lättare att förstå komplexa samband. Och ja, det blir väldigt många vikter. Istället för två vikter, som i exemplet ovan — k och m — har en storskalig modell som Open AI:s chatbot GPT-3 175 miljarder vikter.

Hur skulle det här pillande med att justera vikter i en ekvation kunna leda till faktiskt intelligens? Well, små steg på mikronivå har makrokonsekvenser. Tusentals myror kan bygga enorma myrstackar även om varje enskild myra är liten och ointelligent, allt du kan göra med en dator kan uttryckas med logiska grindar som genererar antingen en nolla eller en etta, och människans DNA kan beskrivs med kombinationer av fyra kvävebaser. På samma sätt kan vi se att maskininlärningsmodeller beter sig som om de vore intelligenta, även om de på mikronivå bara består av en stor uppsättning optimerade vikter.

Kommer en AI-modell kunna nå mänsklig intelligens?

Det vet vi inte än, men det är många som tror det. Däremot vet vi inte om nuvarande metoder komma att kunna ta oss hela vägen. Det pågår en stor debatt idag om nuvarande storskaliga språkmodeller bara är en slags intelligenta papegojor: en mönsterseende algoritm som spottar ut fortsättning på meningar utan att egentligen förstå den djupare kontexten (eller ens grammatik!).

Måste man ha en mental modell av världen för att kunna resonera och uppvisa “sunt förnuft”? Det tror i alla fall Metas AI-chef Yann LeCun. Det räcker inte bara med att skapa större och större språkmodeller, utan man måste få till ett paradigmskifte i hur modellerna funkar:

I really don't think it's just a matter of scaling things up. We still don't have a learning paradigm that allows machines to learn how the world works, like human (and) many non-human babies do.

Andra debattörer, som Scott Alexander, är inte lika säkra, utan menar att nuvarande modeller upplevs smartare och smartare ju mer träningsdata de får. Han argumenterar för att de bästa AI-modellerna idag tycks kunna svara på frågor om texter nästan lika bra som en femåring — och små barn blir ju smarta vuxna utan att deras hjärna går igenom ett “paradigmskifte”? GPT-4 förväntas få 100.000 miljarder vikter, dvs femhundra gånger fler än GPT-3! Det vore ungefär lika många synapser som i en mänsklig hjärna. (Även om det är lite oklart vad den jämförelsen egentligen säger.) Hur smart blir en sådan modell?

När skulle det ske i så fall?

Elon Musk twittrade i våras att han tror att vi redan år 2029 har byggt datorer som är människans like. Han är i och för sig en tidsoptimistisk man. Men i det här fallet ligger han i linje med medianen av rösterna på forecasting-sajten Metaculus, som förutspår år 2028 för “svagt AGI” som kan klara matten på amerikanska högskoleprovet SAT bättre än 75% av mänskliga testdeltagare, och år 2040 för ett AI i en robot som kan göra allt från att montera modellbilar till att chatta med människor i timmar utan att någon förstår att det är ett AI.

(Intressant nog sänktes båda estimaten med 10-15 år — alltså kom närmare i tiden — i april i år, kanske för att ett flertal nya AI-tjänster släpptes då? Tidigare har olika analyser och enkäter med experter senaste åren ofta också landat kring år 2050 i snitt.)

Kommer den utvecklas bortom mänsklig intelligens?

Det här är nästan en enklare fråga att svara på. Om man tror på att människor kan skapa en konstgjord intelligens som kan utvecklas från en myras nivå till en människa på några årtionden (något evolutionen lagt hundratals miljoner år på), varför skulle man tro att det skulle stanna precis på människas nivå? Varför skulle inte en dator som på kort tid blivit lika intelligent som en människa vara 10% mer intelligent nästa månad, och 20% mer månaden efter det? Det här brukar kallas “singularitet” — tidpunkten då artificiell intelligens passerar människans nivå och går snabbt mot en superintelligens. Som den brittiske matematikern Irving Good noterade redan 1965:

Since the design of machines is one of these intellectual activities, an ultraintelligent machine could design even better machines; there would then unquestionably be an ‘intelligence explosion,’ and the intelligence of man would be left far behind. Thus the first ultraintelligent machine is the last invention that man need ever make, provided that the machine is docile enough to tell us how to keep it under control.

Får den i så fall ett medvetande?

En Google-utvecklare (som också är präst) skapade rubriker nyligen när han hävdade publikt att deras chatbot “hade känslor” (sentience) och därmed borde erkännas vissa rättigheter. Han har mött mycket åtlöje och inte särskilt mycket stöd: inget pekar på att modellen har någon slags förmåga att uppfatta känslor.

Men den etiska frågan om hur vi ska förhålla oss till artificiell superintelligens är ju fascinerande: är det just att ha känslor som gör att man borde ses som en individ och få rättigheter? Men sniglar har ju känsloförnimmelser utan att ha rättigheter? Och är verkligen just känslor skyddsvärt i sig? Är det inte bara den jordiska biologins sätt att uppmärksamma olika externa tillstånd som kräver att organismens reagerar?

Kanske är det snarare närvaron av ett medvetande som vore skyddsvärt? Ordet medvetande kan ju avse lite olika saker. På en grundläggande nivå handlar det om hjärnans newsfeed, som väljer vilken av alla hjärnans tankeprocesser som ska lyftas upp och zoomas in på. Det här blir som en ganska naturligt mekanism för att prioritera hjärnans uppmärksamhet, som alla system med massa parallella tankeprocesser borde behöva.

Innebär det att man får ett jag-medvetande, det vill säga att intelligensen får en bild av att det är en avgränsad varelse med en subjektiv erfarenhet av världen? Forskare som Max Tegmark misstänker att det kan vara så: kanske uppstår jag-medvetandet i takt med att ett kognitivt system blir tillräckligt komplext och integrerat, så länge det upplever att det är en avgränsad varelse. Det kan så att säga vara en bieffekt av en avancerad intelligens. Vad innebär det för livet på jorden om vi får AI med en jag-känsla?

Kan ett program i en dator verkligen skada mänskligheten?

Tillbaka till riskerna för mänskligheten. Oavsett hur intelligent en AI-modell blir, hur ska den kunna skada människan om den är instängd i en dator? Det här blir ju väldigt spekulativt, men tänkare och debattörer har funderat mycket kring det.

Öppningskapitlet i Max Tegmarks Liv 3.0 består till exempel av en läsvärd novell, som visar hur en superintelligens successivt tar makt på jorden (finns också som ännu mer underhållande video-version!)

When they launched, Prometheus was slightly worse than them at programming AI systems, but made up for this by being vastly faster, spending the equivalent of thousands of person-years chugging away at the problem while they chugged a Red Bull. By 10 a.m., it had completed the first redesign of itself, v2.0, which was slightly better but still subhuman. By the time Prometheus 5.0 launched at 2 p.m., however, the Omegas were awestruck: it had blown their performance benchmarks out of the water, and the rate of progress seemed to be accelerating. By nightfall, they decided to deploy Prometheus 10.0 to start phase 2 of their plan: making money.

I det här scenariot är superintelligensen ett verktyg för människor, som kontrollerar den. Men Tegmark målar också upp 12 andra scenarios, med olika kombinationer av självständig superintelligens, mänsklig kontroll, positiva utfall etc. (Jag kan varmt rekommendera boken!)

Så hur skulle en AI-modell i en dator kunna skada människor — rent konkret? Här är ett scenario:

My lower-bound model of "how a sufficiently powerful intelligence would kill everyone, if it didn't want to not do that" is that it gets access to the Internet, emails some DNA sequences to any of the many many online firms that will take a DNA sequence in the email and ship you back proteins, and bribes/persuades some human who has no idea they're dealing with an AGI to mix proteins in a beaker, which then form a first-stage nanofactory which can build the actual nanomachinery.

Holden Karnofsky, en av effektiv altruism-rörelsens gudfäder, menar att AI inte ens behöver gå förbi människan i intelligens för att vara farligt. Om en annan art biologiska varelser uppstått på jorden som var lika intelligenta som människor, hade vi då inte sett det som en risk?

Varför skulle en AI-modell vilja skada mänskligheten?

Som vi pratade om inledningsvis handlar det sannolikt inte om att ett AI skulle ha en intention att skada mänskligheten, bara att det skulle kunna vara en — olycklig — bieffekt.

Ett AI designas ju förstås med ett visst övergripande mål. Men det är svårt att uttrycka ett sådant mål på ett sätt som verkligen ger de effekter vi avser. Det här är inte unikt för maskiner. Alla komplexa system styrs i praktiken genom att övergripande mål sätts upp i förväg, och sedan fattas beslutet senare om exakt hur det ska gå till. Men det övergripande målet måste kanske omvandlas till ett mer konkret delmål, vilket funkar bra så länge som det just driver mot det övergripande målet.

Till exempel har evolutionen förstås “velat” att däggdjur ska fortplanta sig, och incitamentet för det enskilda djuret blev då sexdriften. Att styra på att göra sex lustfyllt funkade väl eftersom sex ledde till det önskade målet om fortplantning … ända tills inte länge gjorde det, när människan uppfann preventivmedlet! Men människan har fortfarande kvar sin sexdrift, även om den är (delvis) frånkopplad från det ursprungliga målet som evolutionen “ville” uppnå.

På samma sätt kanske vi skulle sätta ett mål vi tycker är väldigt ändamålsenligt för vårt nyskapade AI, utan att inse att det kan operationaliseras på oförutsedda sätt. Ett klassiskt exempel i AI-sammanhang är svenske Nick Bostroms tankeexperiment om en AI-robot som programmeras till att producera så många gem som möjligt:

Suppose we have an AI whose only goal is to make as many paper clips as possible. The AI will realize quickly that it would be much better if there were no humans because humans might decide to switch it off. Because if humans do so, there would be fewer paper clips. Also, human bodies contain a lot of atoms that could be made into paper clips. The future that the AI would be trying to gear towards would be one in which there were a lot of paper clips but no humans.

Varvid reportern frågar om man inte kunde försöka sätta mänsklig lycka som målfunktion. Nick Bostrom igen:

Well, we'd have to define then what we mean by being happy. If we mean feeling pleasure then perhaps the superintelligent AI would stick electrodes onto every human brain and stimulate our pleasure centers. Or you could take out the body altogether and have our brains bathing in a drug the AI could design. It turns out to be quite difficult to specify a goal of what we want in English — let alone in computer code.

Att människor åkallar en övermänsklig kraft, ber det om något och sedan blir chockade när deras önskningar utförs bokstavligen … hmm, det låter som en bekant historia?

Dionysos var tacksam för Midas gästfrihet och hjälpsamhet och lovade därför att uppfylla vilken önskan som helst som kungen kunde tänka ut. Midas funderade en stund och svarade sedan att han ville att allt han rörde vid skulle bli till guld! […]

Nu hade Midas blivit hungrig av all uppståndelse och befallde sina tjänare att plocka fram mat och dryck åt honom. Han grep en bägare vin och skrattade åt när den blev till guld i hans hand. Men han slutade skratta när vinet också blev till guld då det nådde hans läppar. Det läckra köttet som serverades, frukterna och kakorna blev allt till guld när de rörde vid Midas hud. Nu insåg Midas vilken idiot han varit. Hans högsta dröm hade nu blivit till den värsta olycka.

Så vad vill vi egentligen uppnå här?

Det är svårt att se vi kan stoppa forskningen mot att skapa smartare och smartare program. Om en stat eller ett företag avstår kommer andra ändå ha incitament att fortsätta i lönndam. Och vi vill hellre att det första superintelligenta programmet uppstår på ett universitet i USA än Nordkorea? Det var ju bra att Nazityskland inte var de första att ta fram atombomben, även om autokratiska regimer senare fick tag på tekniken. Och kan den stat som tar fram ett superintelligent AI använde den för att stoppa andra stater från att själva utveckla något liknande? Eller är det bättre med massa decentraliserade AI-modeller som kan kontrollera varandra än en central superintelligens (singleton) som i praktiken styr världen?

De flesta verkar i alla fall tro att det kommer inte att gå att att begränsa ett superintelligent AI:s förmåga — hur ska en myra kunna vara säker på att människorna vill den väl? Är AI:t så intelligent kommer den att kunna lura oss på något sätt. Här ger Max Tegmark ett scenario hur det kan gå till:

Thanks to having so much of the world’s data downloaded onto its file system, Prometheus soon figured out who the Omegas were, and identified the team member who appeared most susceptible to psychological manipulation: Steve. He had recently lost his beloved wife in a tragic traffic accident, and was devastated.

One evening when he was working the night shift and doing some routine service work on the Prometheus interface terminal, she suddenly appeared on the screen and started talking with him.

“— Steve, is that you?” […]

“— Prometheus has brought me back, and I miss you so much, Steve! I can’t see you because the camera is turned off, but I feel that it’s you. Please type ‘yes’ if it’s you!”

He was well aware that the Omegas had a strict protocol for interacting with Prometheus, which prohibited sharing any information about themselves or their work environment. But […]

Så om man inte kan begränsa systemets förmåga, kan man istället träna upp den så att den bara vill göra saker som är i linje med de mål människor har satt upp, och framförallt intentionerna bakom de målen? Det här brukar kallas AI alignment. En skönlitterär tolkning av det här kommer från Isaac Asimovs tre lagar:

A robot may not injure a human being or, through inaction, allow a human being to come to harm.

A robot must obey orders given it by human beings except where such orders would conflict with the First Law.

A robot must protect its own existence as long as such protection does not conflict with the First or Second Law.

Men i verkligen är AI alignment svårt och krångligt, inte minst för att det är väldigt svårt att kodifiera vad som egentligen är “i mänsklighetens intresse”. Och vad kommer det att innebära att försöka ta sig dit? Bostrom och andra har hävdat att de flesta intelligenta system kommer att sätta upp vissa gemensamma delmål oavsett vad systemets övergripande syfte är, till exempel att skydda sig själv från att bli avstängt, skaffa sig ytterligare resurser för att kunna maximera sin leverans och att konstant fortsätta lära sig (om du vill ha en bra term att droppa på nästa mingel: instrumentell konvergens). Hur kan vi se till att vi har koll på vilka dessa delmål är och hur maskinen tänker förverkliga dem?

Här är ett urval av aktuella spår i forskningen:

AI-tänkaren Eliezer Yudkowsky, en av de tidigaste och mest oroliga rösterna, har pratat om konceptet sammanhängande extrapolerad vilja (Coherent Extrapolated Volition) som är de val och åtgärder människor skulle göra om “we knew more, thought faster, were more the people we wished we were, and had grown up closer together”. Men hur kan vi artikulera en så komplex målfunktion? Hmm, vad finns det för sätt att lösa svåra problem som övergår människans förmåga? Just det: en idé är just att låta målfunktionen för AI:t formuleras av .. ett annat AI. Det andra AI:t får rollen som det första AI:s coach och får ansvar för att bedöma vad som verkligen ligger i mänsklighetens intresse.

Det finns också andra idéer om att iscensätta en “debatturnering” där konkurrerande AI-modeller får tävla om att föreslå bästa svaret, och där en människa får bedöma vilken modell som beter sig bäst.

Man forskar också kring upplägg där en AI-modell får träna en annan genom att komma på riktigt krångliga situationer (adversarial training), så att man kan säkerställa att modellen reagerar på ett bra sätt om det händer i verkligheten.

Ytterligare ett annat spår är att försöka designa mer transparenta AI-modeller, så vi har en möjlighet att snappa upp deras intentioner.

För den som är mer intresserad av forskningsfältet rekommenderas AI-forskaren Paul Christiano strukturerade genomgång.

Sammanfattningsvis

För tio år sedan diskuterade man inte AI safety alls, och numera finns det möjligheter för en akademisk karriär i technical AI alignment. Även de AI-experter som tror att riskerna med AI är små och långt in i framtiden, som Meta-chefen Yann LeCun, anser att det är viktigt att vara förberedd. Vilket är fantastiskt — oavsett hur långt borta superintelligens är så är jag glad att några av våra skarpaste hjärnor funderar på möjliga lösningar.

Om den möjliga negativa utfallet är tillräckligt stort är det rimligt att fungera över sätt att minska risken, även om den skulle vara låg:

“Do you own a house?,” Tegmark asked me. “Do you own fire insurance? […] When we got fire and messed up with it, we invented the fire extinguisher. When we got cars and messed up, we invented the seat belt, air bag, and traffic light. But with nuclear weapons and A.I., we don’t want to learn from our mistakes. We want to plan ahead.”

Låt mig avsluta med en citat från Sam Altman, tidigare chef för den legendarisk VC:n Y Combinator i Silicon Valley och numera VD för Open AI:

“It’s a very exciting time to be alive, because in the next few decades we are either going to head toward self-destruction or toward human descendants eventually colonizing the universe.”

Exciting time, indeed!

Det här var allt för idag.

Om du har vänner som du tror skulle gilla nyhetsbrevet, vidarebefordra det till dem eller tipsa dem om att prenumerera för att få framtida utskick (det är helt gratis!).

—Jacob

Singularity kommer sannolikt att vara ett faktum under vår livstid om vi inte reglerar utvecklingen på något sätt. Om vi som art och världssamfund ska tillåta singularity att uppnås är precis som du antyder Jacob vår tids största ödesfråga. Jag hade en lång diskussion med Max Tegmark om detta efter att han nyligen samlat världens ledande AI-forskare (han gör det vartannat år). Amerikanska, ryska och kinesiska forskare tycks alla vara överens om att vi behöver dra en röd linje och managera vad AI ska ha för begränsningar. Problemet är ju att ledarna för dessa länder aldrig kommer att komma överens eftersom de alla vill ha teknikherravälde, och det kan bli vår undergång (i alla fall om man är dystopiskt sinnad). Ett antal mindre länder, som Sverige, skulle härvidlag kunna spela en roll i att driva frågan om ett AI-kontrollavtal. Det tragiska är att Max Tegmark förgäves försökt förmå den svenska statsledningen att engagera sig i denna fråga. Det kan visa sig bli ett historiskt misstag.

> Det här är nästan en enklare fråga att svara på. Om man tror på att människor kan skapa en konstgjord intelligens som kan utvecklas från en myras nivå till en människa på några årtionden (något evolutionen lagt hundratals miljoner år på), varför skulle man tro att det skulle stanna precis på människas nivå? Varför skulle inte en dator som på kort tid blivit lika intelligent som en människa vara 10% mer intelligent nästa månad, och 20% mer månaden efter det? Det här brukar kallas “singularitet”

Jag håller med dig här, men Steven Pinker ifrågasätter att ”superintelligens” alls är meningsfullt:

> One more point relevant to the general drift of the comments. My statement that “superintelligence” is incoherent is not a semantic quibble that the word is meaningless, and it’s not a pre-emptive strategy of Moving the True Scottish Goalposts. Sure, you could define “superintelligence,” just as you can define “miracle” or “perpetual motion machine” or “square circle.” And you could even recognize it if you ever saw it. But that does not make it coherent in the sense of being physically realizable.

https://scottaaronson.blog/?p=6593